Stable Diffusionとは?話題の画像生成AIの使い方と注意点

はじめに

- Stable Diffusionはテキストから高品質な画像を生成する最先端のAI技術のこと

- 利用者は英語でプロンプトを入力することにより、具体的な画像を作成できる

- 画像生成したものを商業利用する際は著作権に注意する

- 日本語での使用には「AIりんな」が利用できる

- プロンプトの工夫次第で、より理想的な画像生成が可能になる

時代はデジタル化が進み、画像生成においてもAI技術が大きな役割を果たすようになりました。近年、注目されている画像生成AIの1つに英国のStability AI社が開発した「Stable Diffusion」があります。

この記事では、Stable Diffusionの基本から実際にどのように利用するか、そして利用時に気を付けたいポイントについて、明快にご紹介します。

Stable Diffusionとは何か?

Stable Diffusion(ステイブル・ディフュージョン)は、記述したテキスト(プロンプト)から緻密な画像を生成するAI技術です。Stable Diffusionには「訓練済のAIモデル(Diffusion Model)」が搭載されています。

Stable Diffusionは、入力されたテキストに基づいて、実際に存在しない画像を創出します。

AIによる画像生成と聞くと複雑に感じるかもしれませんが、その使用方法は非常にシンプルです。プロンプトを入力する際は、文章で記述しても単語で区切って入力してもどちらでも構いませんが、基本的には英語で記述する必要があります。

また、プロンプト内容とは関係ない画像が出力されたり、イメージ通りの画像が出力されなかったりすることもあります。他には、商業利用や著作権に関する注意点なども理解することが重要です。

Stable Diffusionの主な特徴

Stable Diffusionは、画像生成に革命をもたらしたAI技術の一つとして知られています。最大の特徴は、その生成能力の高さにありますが、それだけではありません。

ユーザフレンドリーな操作性、カスタマイズ可能なオプション、迅速な処理速度もこのツールの強みです。

また、オープンソースとしてのアクセスのしやすさも、幅広いユーザに受け入れられている理由の一つです。このセクションでは、Stable Diffusionの特徴を具体例を交えて掘り下げていきます。

高品質な画像生成能力

Stable Diffusionがとくに評価されている点は、その高品質な画像生成能力です。このAIは、「潜在拡散モデル(Latent Diffusion Models)」という方式を採用しています。

潜在拡散モデルでは、潜在空間(圧縮された空間)で変換作業を行うことにより、計算の負荷を減らしつつ高品質な画像を出力できます。ユーザは指示をテキストで打ち込むだけなので、複雑なアルゴリズムを理解したりプログラムコードを記述したりする必要はありません。

このプロセスは、クリエイティブな領域での表現の自由度を大きく広げています。利用者は、単純な指示から複雑なビジョンまで、あらゆるアイディアを視覚化する強力な助けとしてこの技術を用いることができます。

Stable Diffusionの注意点と制限

Stable Diffusionは多くの可能性を秘めていますが、使用する際には注意点があります。

次のセクションでは、これらの法的な側面や技術的制約について詳しく説明します。

著作権と使用上の注意点

Stable Diffusion以外でも、画像生成AIを利用する際は、著作権を意識して利用しましょう。生成された画像が既存の著作物に似ている場合、著作権侵害となるリスクがあります。

たとえば、ローカル環境で利用できる「Stable Diffusion web UI」ツールでは、「txt2img」と、「img2img」の2パターンから選べます。txt2imgとは、テキスト形式で指示を出して画像を生成する手法のことで、img2imgは手持ちの画像を読み込んで新しい画像生成する手法のことを指します。

世間に公開されている作品を「img2img」で使用する際は、AIが学習素材として認識するため、他人の著作権を侵害しないように注意が必要です。

さらに、特定の人物の顔や商標が含まれた画像を生成することは、肖像権や商標権の侵害に繋がる可能性があります。そのため、生成した画像を公開する前には、権利関係を慎重に確認し、必要であれば許可を得ることが重要です。

商用利用する際の注意点

Stable Diffusionを商用目的で使用する場合、さらに慎重な対応が求められます。商用利用には通常、より厳格な著作権の適用があります。

たとえば、先述した、「img2img」で作成した画像は、商用利用できないケースもあることを想定しておきましょう。

AIによって生成された画像を製品や広告に使用する前には、その画像に対する全ての権利を明確にする必要があります。

また、ライセンス条件を遵守することも不可欠です。とくに、オープンソースのツールを商用で利用する際には、そのライセンス条項を詳細にチェックし、必要に応じて法的な助言を求めることが賢明です。

Stable Diffusionの使い方

Stable Diffusionは、インターネット上で簡単にアクセスできるWeb版と、自分のPCにインストールして使用するローカル版の二つがあります。ここでは、それぞれの利用方法を具体的に解説します。

Web版を利用する

Web版Stable Diffusionは、ブラウザから手軽に画像生成を行えるサービスです。ここでは、代表的なWebプラットフォーム「Hugging Face」「Dream Studio」「Mage」の使い方を紹介します。

これらはテキストを入力するだけで画像を生成できるため、手間がかかりません。

それぞれのプラットフォームは独自の特徴を持っており、用途に応じて選択することが可能です。これから特徴と操作方法をご紹介します。

Hugging Face

Hugging Face(ハギングフェイス)は、無料で基本的な画像生成ができ、アカウントを作成しなくても使用できます。テキストボックスに希望の描写を入力し、「Generate image」ボタンを押すだけで、AIが画像を生成します。簡単なステップで美しい画像を作ることが可能です。

以下から使い方をご紹介します。

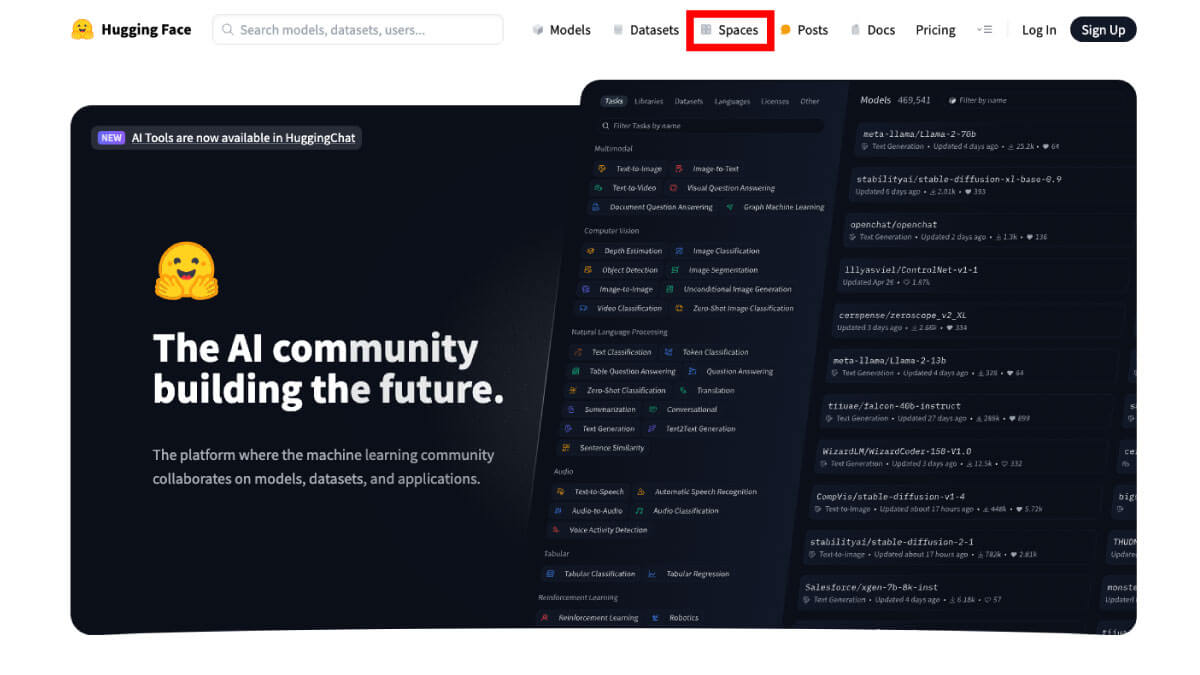

1.以下のサイトにアクセスして「Spaces」をクリックする

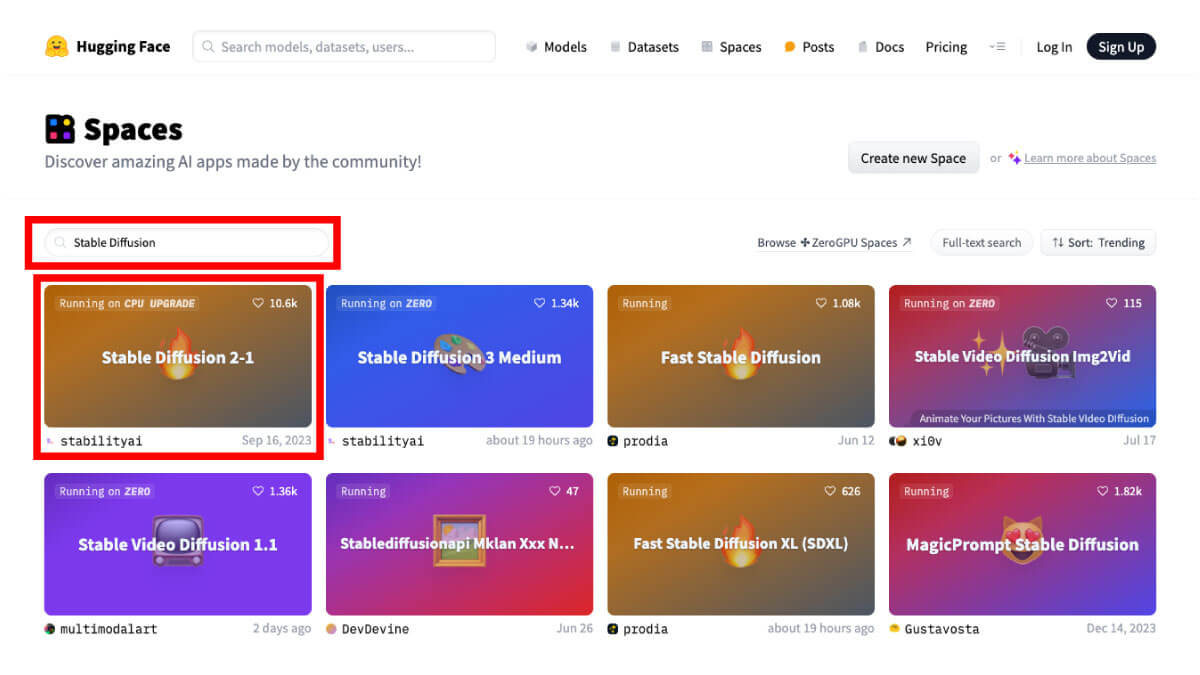

2.検索窓に「Stable Diffusion」と入力するとAIモデルの一覧が表示されるので、「Stable Diffusion 2-1」をクリックする

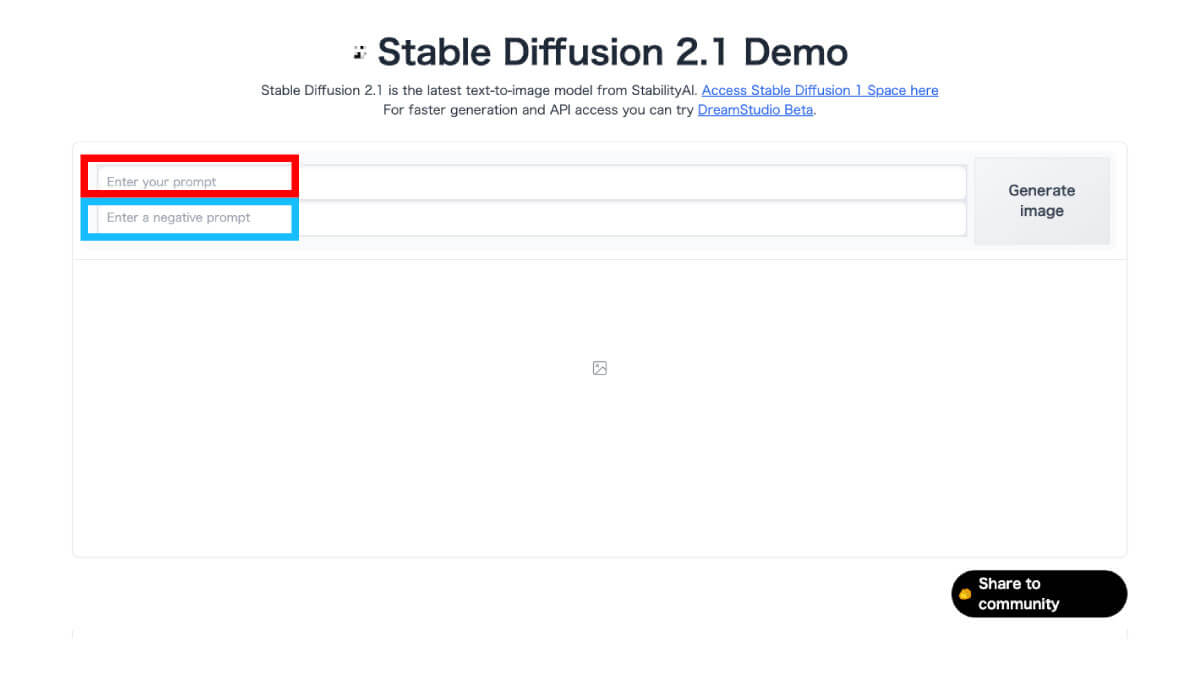

3.赤枠にプロンプトを入力(必要に応じて青枠にネガティブプロンプトを入力)して「Generate image」をクリックする

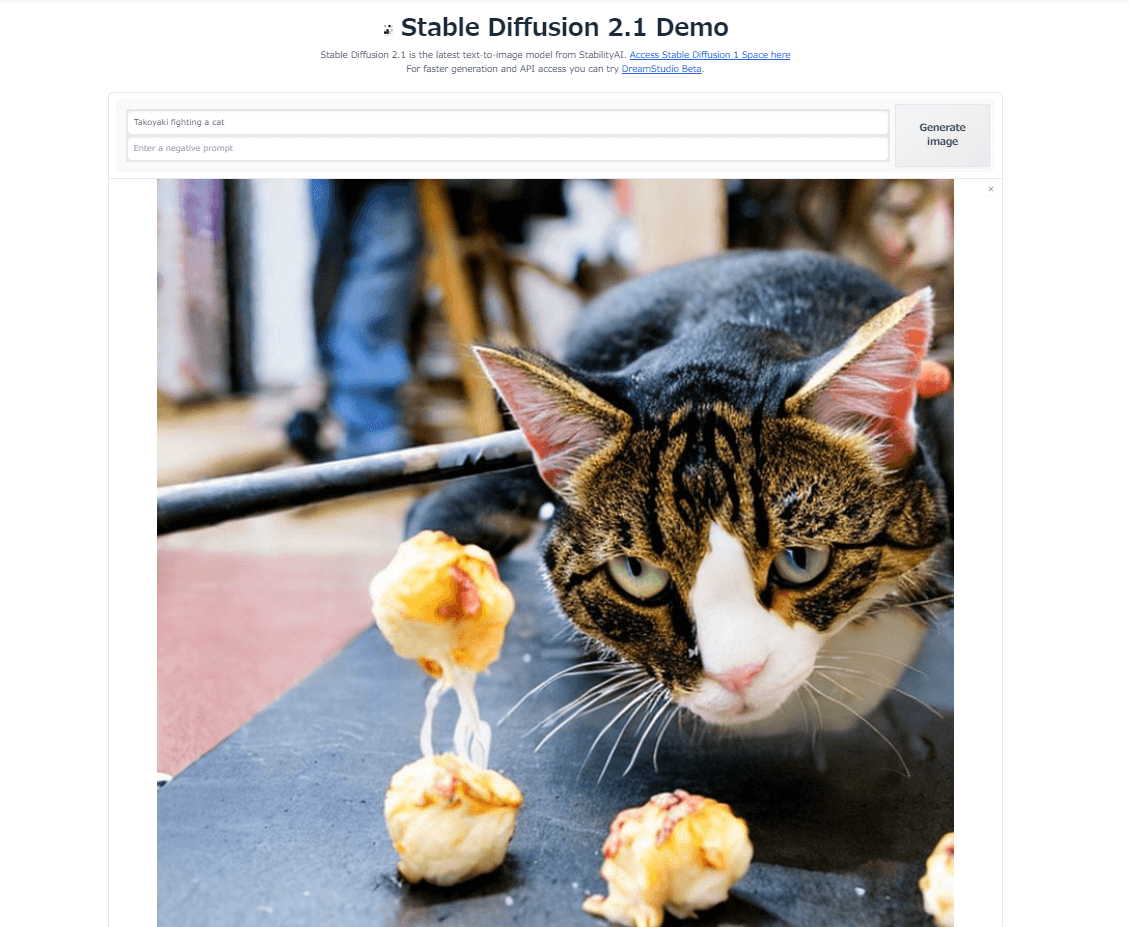

今回はプロンプトに、「Takoyaki fighting a cat.(猫と戦うたこ焼き)」と入力して画像を生成しました。

参考:Hugging Face |The AI community building the future.

Dream Studio

Dream Studio(ドリームスタジオ)は、スタイリッシュなインターフェースと高度なカスタマイズ機能を持つサービスです。こちらも基本的にはテキストを入力して生成する流れですが、色調やスタイルの微調整をプロンプトで入力しなくても、簡単に選択できます。そのため、細かいニュアンスを表現したい場合に適したサービスです。

以下から使い方をご紹介します。

1.下記のサイトにアクセスして「Googleアカウント」「Discordアカウント」「Emailアドレス」でログインする

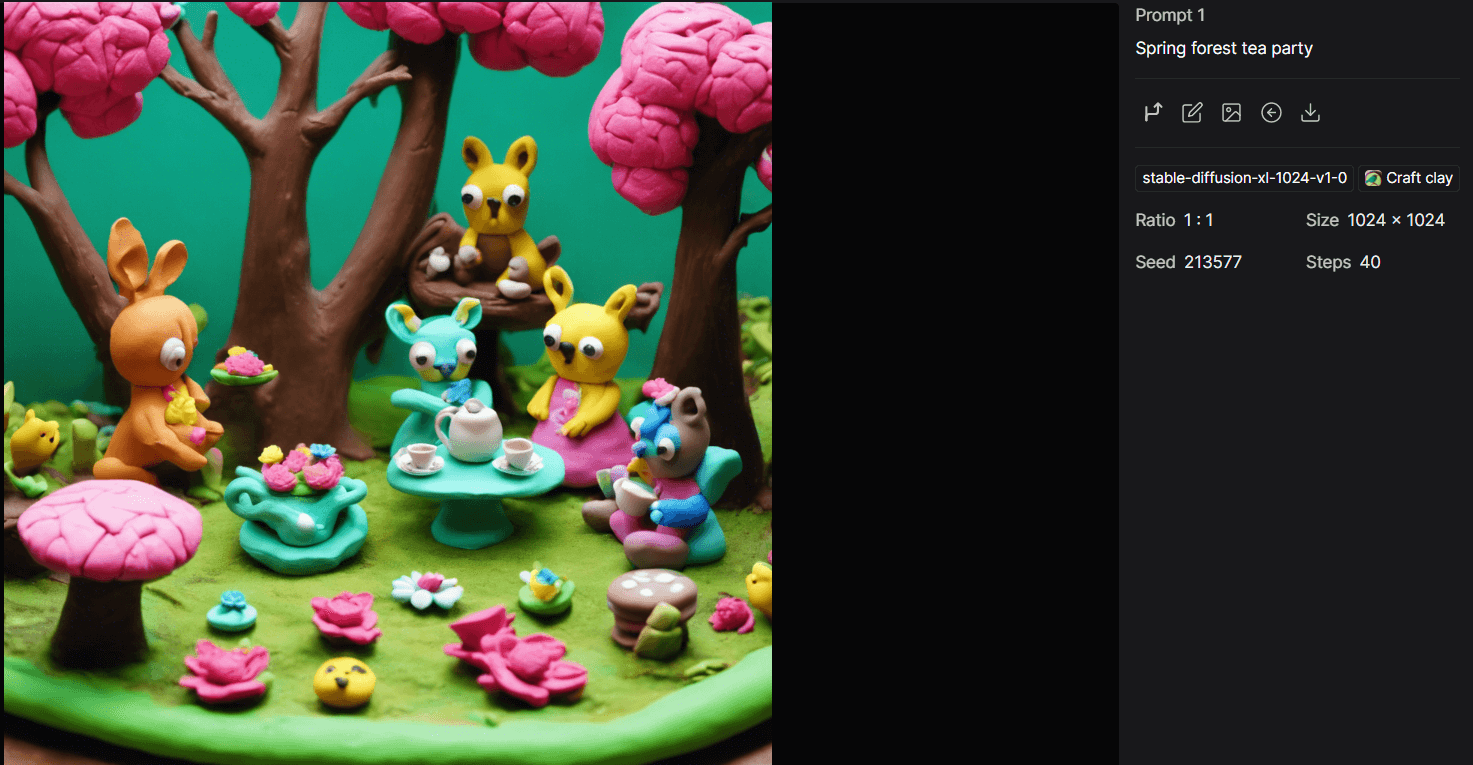

2.ログイン後に、赤枠にプロンプトを入力(必要に応じて青枠にネガティブプロンプトを入力)して「Dream」をクリックする

今回はプロンプトに、「Spring forest tea party.(春の森のお茶会)」と入力して、「Claft clay」「Cinematic」の2つのスタイルを設定しました。

Claft clay

Cinematic

このように、同じプロンプトでもスタイルの指定によっては印象が大きく異なります。

参考:DreamStudio|DreamStudio

Mage

Mage(メイジ)では、直感的な操作で、プロフェッショナルな画像を短時間で作り出せます。

以下から使い方をご紹介します。

1.以下のサイトにアクセスします。

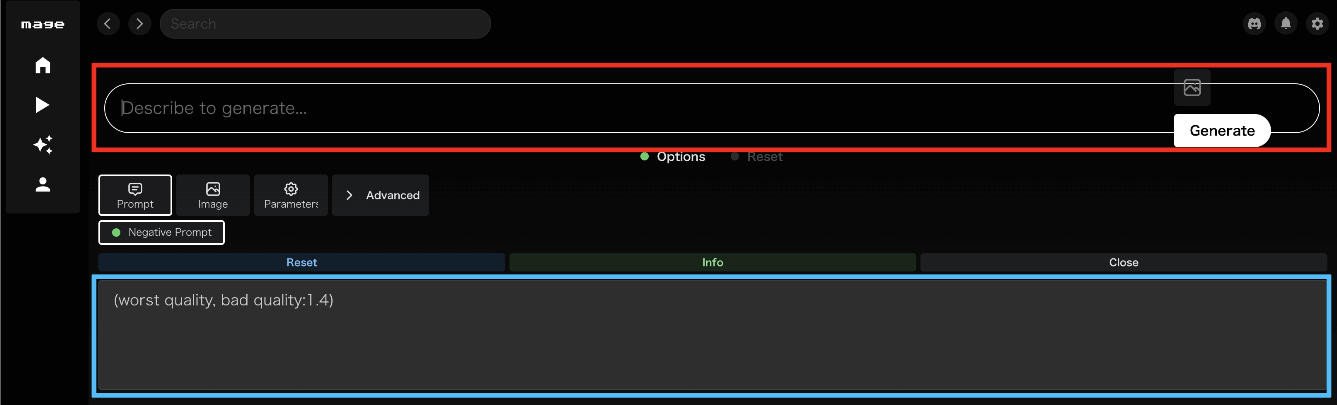

2.赤枠にプロンプトを入力(必要に応じて青枠にネガティブプロンプトを入力)して「Generate」をクリックする

Mageでは、アカウントを作成・ログインしなくても画像を生成できます。ただし、ネガティブプロンプトを入力する際にはログインが必要ですので覚えておきましょう。

今回は2パターンの画像を生成しました。

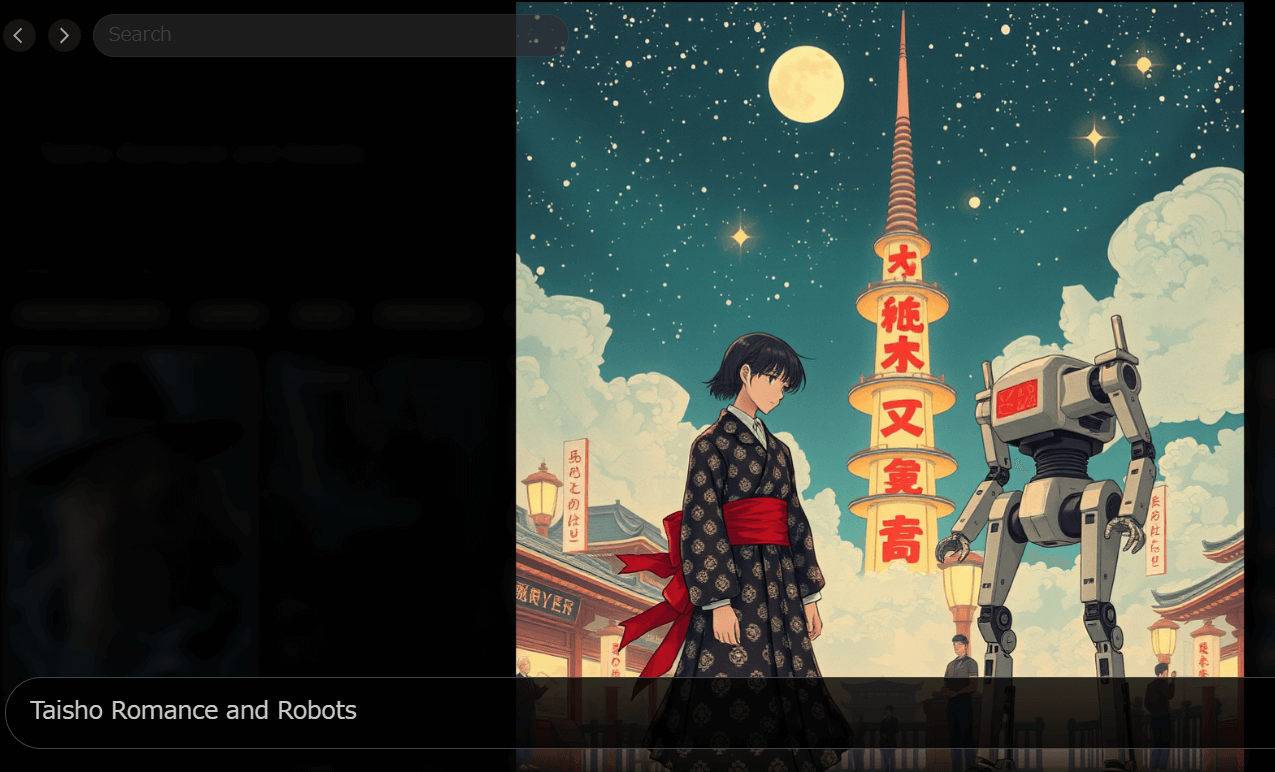

1つ目はプロンプトに、「Taisho Romance and Robots.(大正浪漫とロボット)」と入力して、画像のスタイルや雰囲気については言及しなかったところ、以下のイラストが生成されました。

2つ目は、「miniature. A witch’s kitchen with a view of the spring garden. (ミニチュア。春の庭が見える魔女のキッチン)」としたところ、以下のイラストが生成されました。

今回は、ミニチュアの風景を生成したかったため、プロンプト内に「ミニチュア」という単語を指定しました。生成したい画像をイメージと近づけたい場合は、上記のように具体的な指示を追加しましょう。

参考:Mage | Free, Fast, Fun, Unlimited AI Apps

ローカル版を利用する

ローカル版Stable Diffusionは、パーソナルコンピューターに直接インストールして使用します。Web版は登録や基本操作を覚えるだけで始められますが、ローカル版ではセットアップに少し手間がかかります。

また、必要なPCスペックを備えていないと実行が難しいケースも想定されるため、はじめはクラウド環境での利用がオススメです。

ローカル版Stable Diffusionのセットアップには技術的な知識を必要としますが、生成枚数やプロンプトに制限がありません。また、オープンソースで公開されているため、機能の追加を自由に行えるのもメリットです。そのため、プライバシーを保ちつつ、高速に画像を生成できます。

Stable Diffusionを日本語で使う方法

Stable Diffusionは英語のテキストに最適化されているため、日本語での使用には工夫が必要です。しかし、日本語入力に対応したAIツールも存在します。

たとえば、「AIりんな」は日本語に特化したAIであり、X(旧:Twitter)上で利用可能です。

ユーザは日本語で指示を出すことができ、AIがそれに応じた画像を生成します。このセクションでは、日本語でStable Diffusionを使用するための具体的なステップを説明します。

AIりんな(X:旧Twitter)

AIりんなは、日本語でのプロンプトに応じて画像を生成するサービスです。X(旧:Twitter)上で提供されており、使い方も簡単です。ユーザはAIりんなの「お絵描き会場」へアクセスして、そのポスト(ツイート)にリポスト(リツイート)をすることで、画像生成ができます。

使用前には「Tsukuruサービス利用規約」を読み、正しく使用しましょう。日本語の文脈を理解する能力が高く、細かなニュアンスまで反映された画像を生み出しますが、ポストに「気が向いたら絵を描く」という記述があるため、必ず画像が生成されるとは限りません。

このサービスは多くの人に利用されており、日本語でStable Diffusionを活用する一例といえます。

Stable Diffusionを使う際のコツ

Stable Diffusionで高品質な画像を生成するには、いくつかのコツがあります。プロンプトの入力方法に工夫を凝らし、AIの理解を助けることが重要です。

ここでは、よりよい結果を得るためのプロンプトの書き方について、いくつかのコツをご紹介します。

先に入力したプロンプトが優先される

Stable Diffusionは入力されたプロンプトを順番に解釈するため、画像生成においては、先に(左側に)記載した内容から優先される傾向があります。

また、同じキーワードでも語順を変えると、生成画像に影響する可能性があります。重要な要素は文章の先頭に配置し、その後に詳細を追加することが効果的です。

たとえば、「1.イラスト全体のイメージ」「2.登場するヒト・動物・モノ・風景」「3.2の詳細なイメージ(服装・髪形など)」「構図」といったように抽象的な部分から記載して掘り下げていくといいでしょう。この順序を意識することで、期待に沿った画像が得られやすくなります。

重要な部分はカッコと数字で強調する

特定の要素に重点を置きたい場合、それをカッコで囲み、数字を付けて強調する方法が有効です。

たとえば「(Mountain:5)」のように記述すると、山の描写に5倍の力点が置かれます。このテクニックを駆使することで、AIに対する指示が明確になり、望む特徴を強調した画像が生成されやすくなります。

反対に、特定の要素を弱めることも可能です。たとえば、ヒトの要素を弱めたい場合は、「(Human:0.5)」のように記述するとよいでしょう。

単語の数は75個以内が望ましい

プロンプトを組み立てる際に単語数が多すぎるとAIが混乱し、結果が不安定になることがあるため、プロンプトは簡潔にすることが望ましいです。また、Stable Diffusionでは75個の単語を1単位として扱うため、単語数を75個以内に留めることが推奨されています。

ただし、カンマや数字なども1単位としてカウントされますので、実際の単語数は75個よりも少ない方がいいでしょう。

たとえば、文章の75個目に「white rabbit」という言葉を入力した場合は、「white」が75個目の単語として、「rabbit」が76個目の単語としてカウントされます。その場合、画像が正しく生成されないケースが想定されます。

ネガティブプロンプト(除外するテキスト)を指定する

ネガティブプロンプトは、生成される画像から特定の要素を除外する際に有効です。たとえば、「worst quality」や「low quality」などのプロンプトを含むことで、画像のクオリティ・品質を上げてくれます。

また、画像内に「猫」を含めたくない場合は、「–no cat(猫を含まない)」という指示をプロンプトに追加することで、AIは猫のイメージを避けて画像を作成します。

ただし、ツールによってはこの方式が使えない場合もあるため注意が必要です。先ほどご紹介したWeb版のStable Diffusionでは、いずれもネガティブプロンプトの入力欄がありますので、そちらを活用しましょう。

Stable Diffusionのプロンプト例

Stable Diffusionを最大限に活用するためには、プロンプトの書き方が鍵を握ります。

画像・解像度・世界観・スタイル・構図・角度など、具体的な要望をプロンプトに反映させることで、理想に近い画像の生成が可能になります。

画質や解像度を指定するプロンプト例

プロンプト内にで「4K resolution」や「high detail」といったキーワードを使用することで、高画質な画像が出力できます。

たとえば、「a sunset over the ocean in 4K resolution」のように記述することで、詳細なテクスチャを含んだ鮮明な夕日の画像が期待できます。

解像度の指定は、生成するビジュアルコンテンツのクオリティに直結します。

世界観・雰囲気・作風・スタイルなどを指定するプロンプト例

作品に特定の雰囲気やスタイルを持たせたい場合、それをプロンプトに明示することが重要です。

たとえば、「cyberpunk style neon-lit cityscape」は、サイバーパンクの世界観を反映した都市の風景を生成します。

また、「Van Gogh inspired starry night」は、ゴッホの作風を模した星空の画像を作り出します。こうした指示をプロンプトに組み込むことで、AIは特定のアーティストやジャンルにインスパイアされた作品を生成することが可能です。

構図や角度を指定するプロンプト例

画像の印象は、構図や撮影角度によって大きく変わります。

たとえば、「bird’s eye view of a mountain range」というプロンプトをAIに入力して生成されるのは、山脈を鳥瞰図で捉えた画像です。一方で、「close-up portrait of a woman with green eyes」と指示するとは、緑の目を持つ女性のクローズアップポートレートが生成されます。

構図や角度の指定は、目的とする画像の視覚的なダイナミクスをコントロールするために不可欠です。これらのプロンプトを適切に使用することで、より芸術的な画像を得られるでしょう。

まとめ

Stable Diffusionは、高精細画像を生成するAI技術で、シンプルな操作性とカスタマイズ性を備えています。主に英語のプロンプトに対応していますが、日本語対応ツールも一部展開されています。

著作権を侵害しないように注意する必要はありますが、プロンプトの工夫次第で理想の画像が創造できるため、ユーザは安心してクリエイティブな作業に没頭できるでしょう。